Ik heb de Clever AI Humanizer-tool getest op verschillende soorten door AI geschreven content en ik krijg gemengde resultaten. Soms komt het door detectors en klinkt het natuurlijk, andere keren wordt het gemarkeerd of voelt het ongemakkelijk en te veel bewerkt. Ik hoor graag echte gebruikerservaringen, inclusief welke instellingen, prompts of werkprocessen het echt menselijk laten klinken terwijl het veilig blijft voor SEO, freelancewerk of academisch gebruik.

Clever AI Humanizer: Echte gebruikservaring, geen marketingpraat

Ik ben al een tijd aan het rondneuzen in gratis “AI humanizer”-tools, deels uit nieuwsgierigheid en deels uit zelfbescherming. Veel van die tools vernielen de tekst, beginnen ineens geld te vragen of scoren slechter op detectors dan de originele AI-versie.

Clever AI Humanizer is een van de weinige die ik in mijn favorieten heb laten staan, dus ik besloot een wat gestructureerdere test te doen en op te schrijven wat er nu écht gebeurt als je ’m gebruikt.

Site waar ik het over heb:

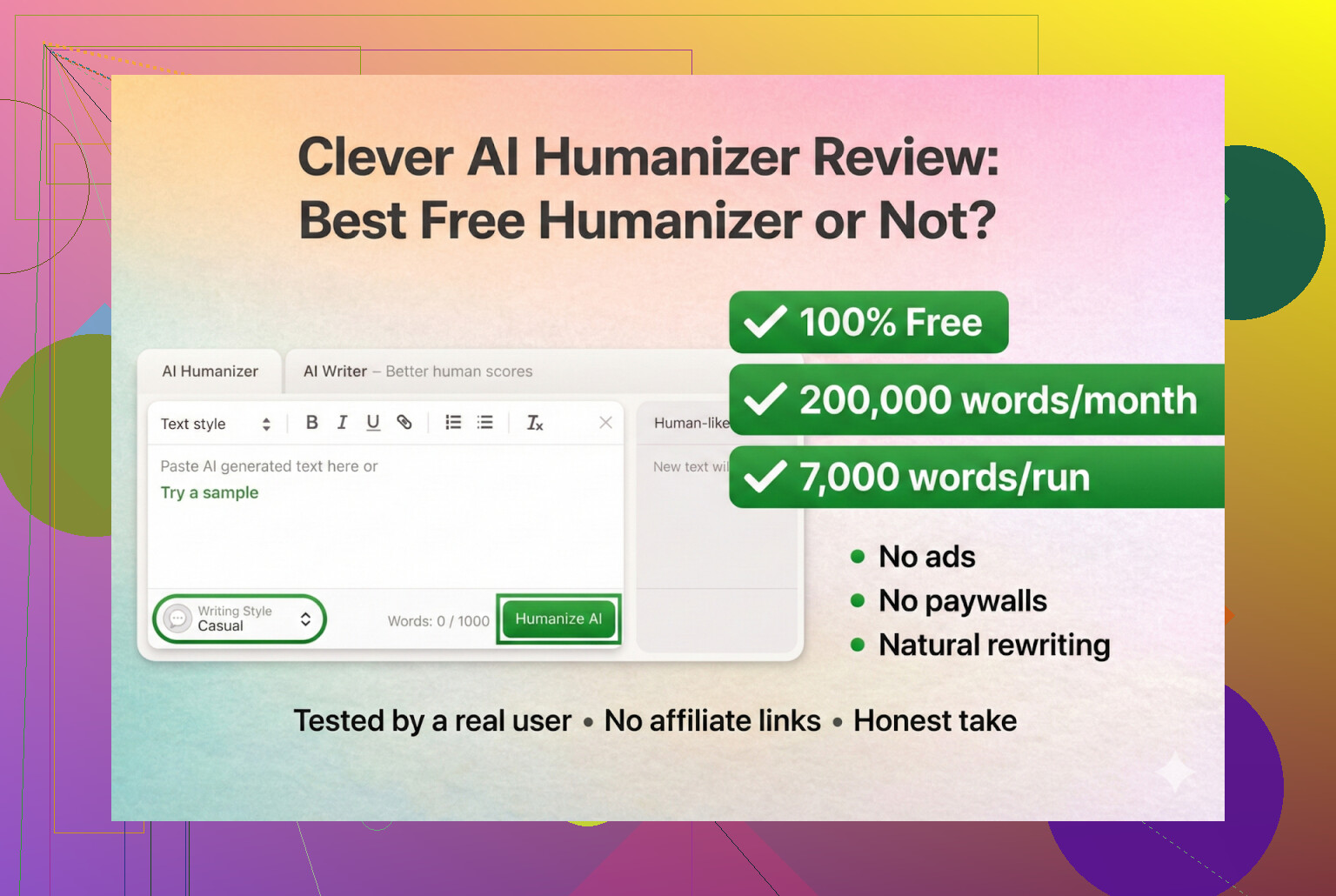

Clever AI Humanizer → Clever AI Humanizer — Beste 100% gratis humanizer

Hun ingebouwde schrijver: https://aihumanizer.net/nlai-writer

Ja, die URL klopt. Er zweven nepversies rond.

Echte site vs willekeurige clones

Dit stuk is belangrijk, zeker als je de tool via advertenties hebt gevonden.

Ik heb meerdere DM’s gekregen van mensen die vroegen naar de “echte” Clever AI Humanizer-link nadat ze per ongeluk op copycat-sites waren beland die via Google Ads op soortgelijke namen adverteerden, en vervolgens klaagden over onverwachte abonnementen en “pro-plannen”.

Mijn ervaring:

- Clever AI Humanizer op Clever AI Humanizer — Beste 100% gratis humanizer

- Tot nu toe geen betaalde abonnementen

- Geen stiekeme paywall of abonnement

- Geen “upgrade om basisfuncties te ontgrendelen”-gedoe

Als je prijspagina’s, maandabonnementen of “Clever Humanizer Pro” ziet dat om je creditcard vraagt, zit je waarschijnlijk niet op de originele site.

Hoe ik hem getest heb

Voor deze ronde ben ik volledig AI vs AI gegaan.

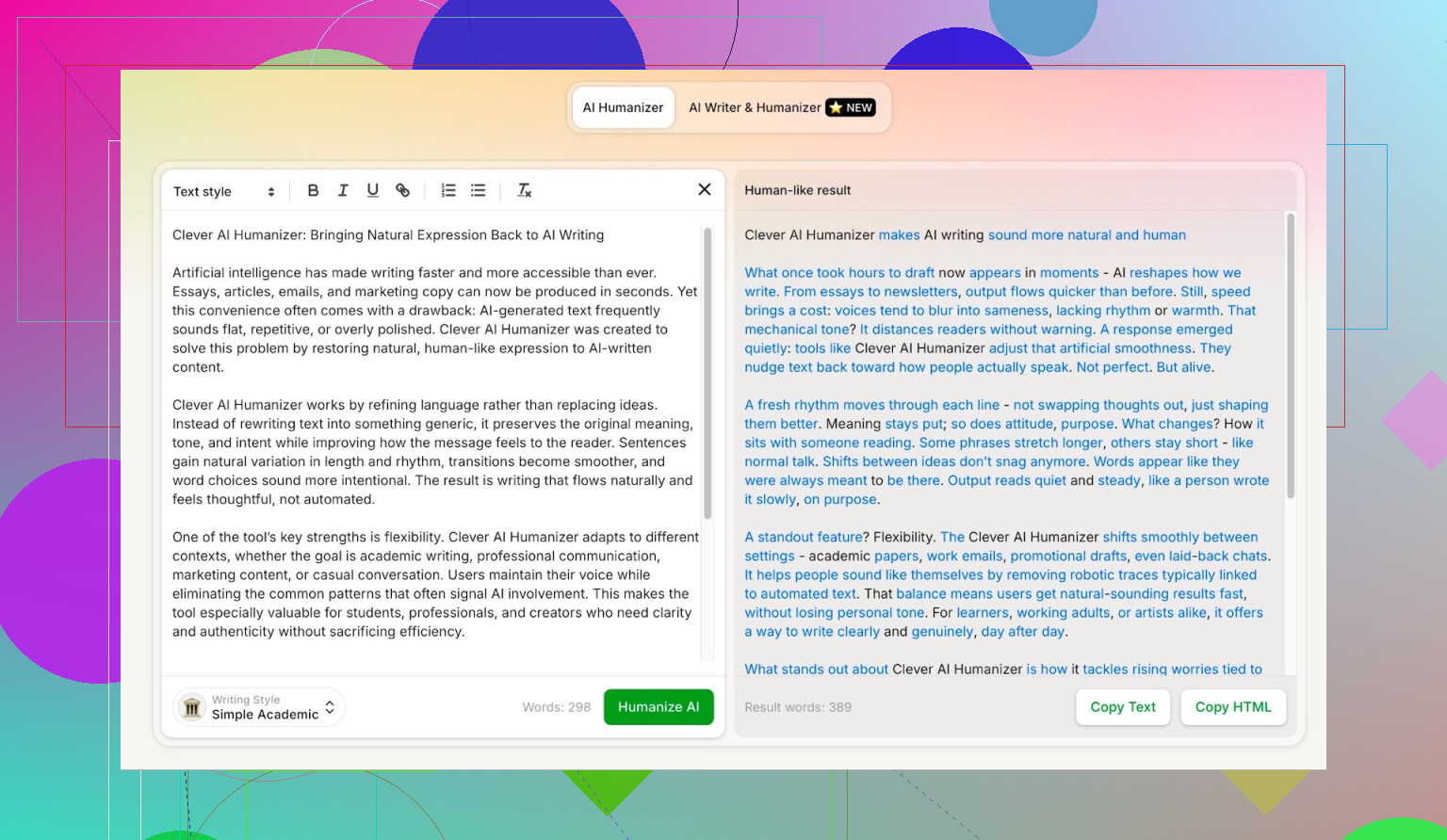

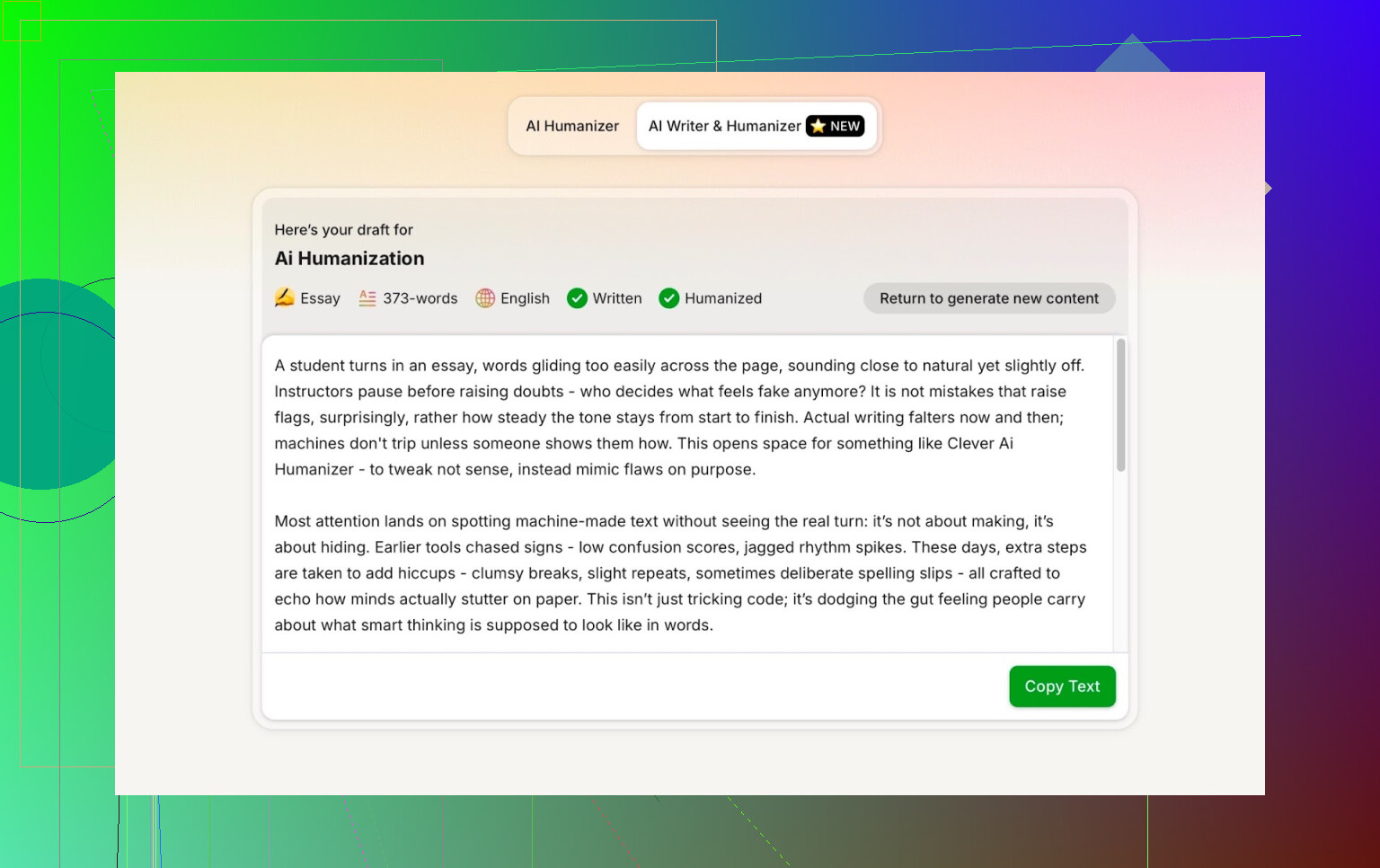

- Ik heb ChatGPT 5.2 een volledig AI-geschreven artikel laten maken over Clever AI Humanizer.

- Daarna heb ik die tekst door Clever AI Humanizer gehaald in de modus Simple Academic.

- Vervolgens heb ik gekeken naar:

- AI-detectorscores

- Leesbaarheid

- Grammatica en stijl

- Hoeveel de betekenis verschoof

Simple Academic is een wat aparte maar interessante stijl. Het is niet extreem academisch, maar klinkt wel alsof een student het voor een niet al te formele opdracht heeft ingeleverd. Die “tussenstijl” werkt verrassend goed om detectors te omzeilen.

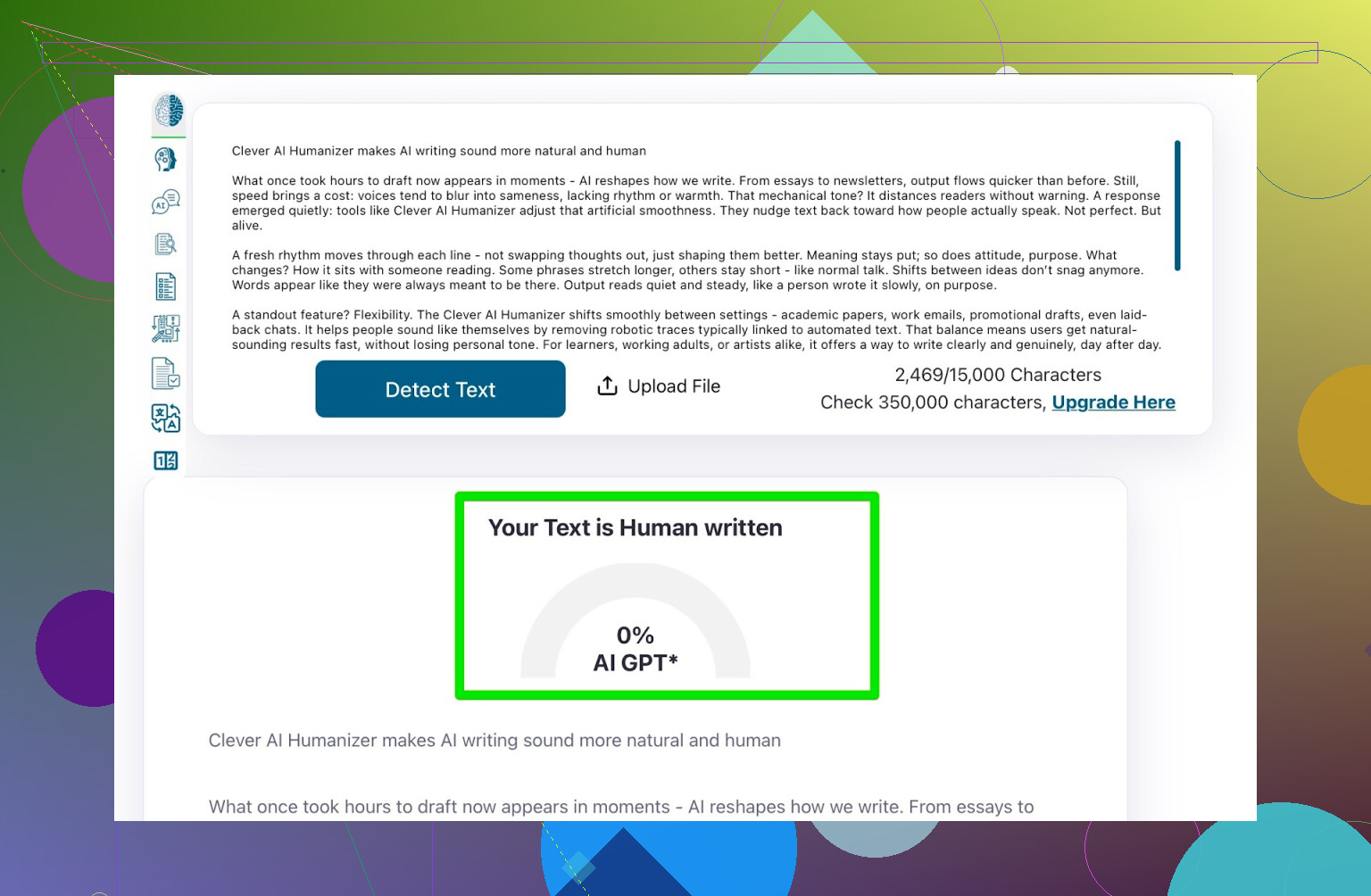

Detectorcheck: ZeroGPT & GPTZero

Eerste test: de gehumaniseerde tekst door de bekende detectors halen.

ZeroGPT

Als je ooit detectors hebt gebruikt, heb je ZeroGPT waarschijnlijk bovenaan in Google zien staan.

Persoonlijk zie ik het niet als een ultieme autoriteit. Ik heb het de Amerikaanse grondwet “100% AI” zien noemen, wat genoeg zegt over hoe ruisgevoelig dit soort tools kan zijn.

Maar veel docenten, opdrachtgevers en bedrijven gebruiken het nog steeds, dus het telt wel mee.

- Resultaat voor de output van Clever AI Humanizer: 0% AI

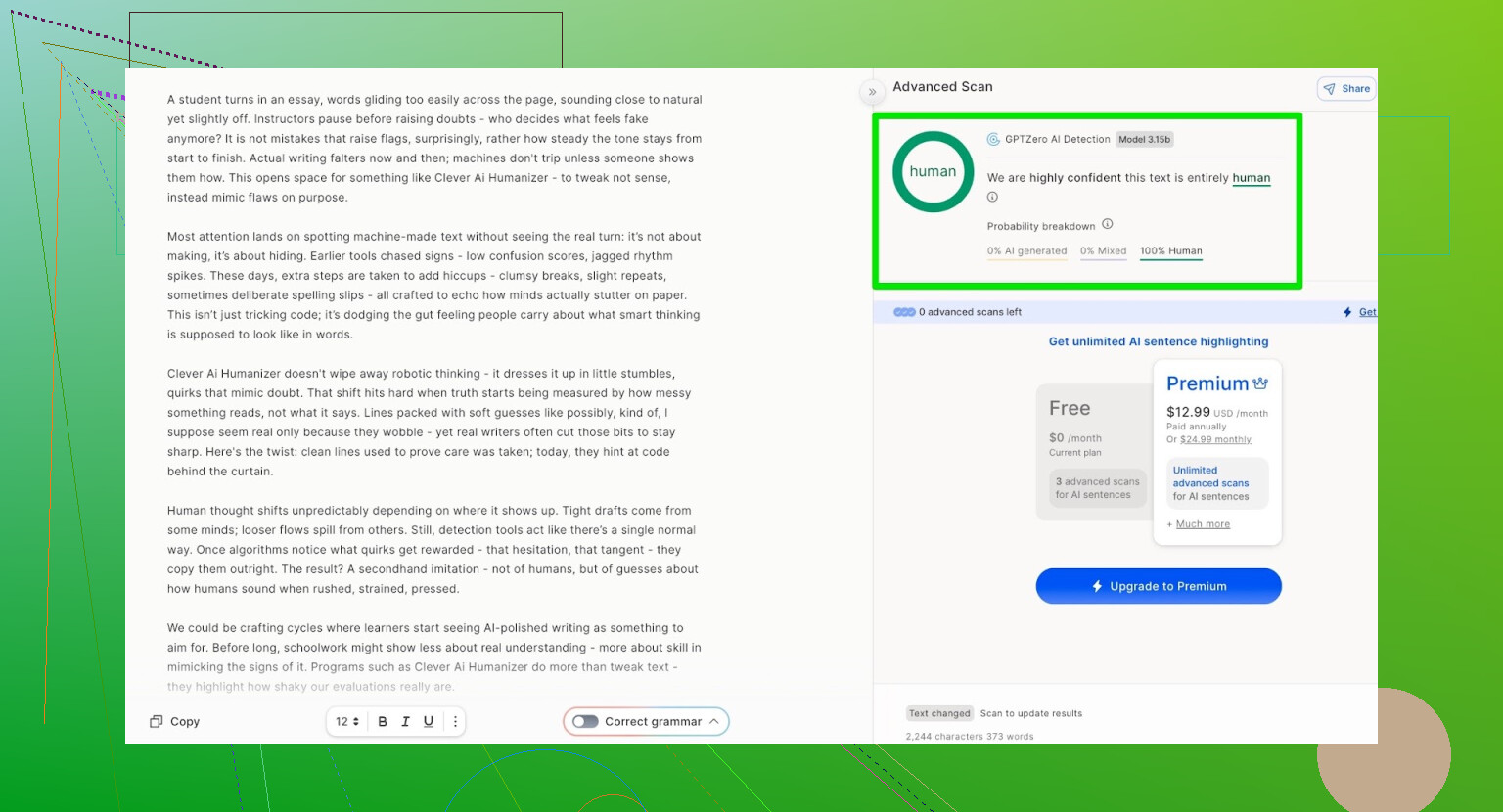

GPTZero

Daarna heb ik GPTZero geprobeerd, de andere grote naam die graag wordt genoemd in beleidsteksten en universiteitsmails.

- Resultaat: 100% menselijk, 0% AI

Als je enige doel is “zorg dat de detectors rustig blijven”, dan doet Clever AI Humanizer dit bij deze twee dus gewoon goed.

Maar daarmee ben je er nog niet.

Klinkt de tekst echt alsof een mens hem heeft geschreven?

Detectors passeren is mooi, maar als de tekst daarna nog steeds klinkt als een robot die een scriptie probeert na te doen, heb je er weinig aan.

Dus ik heb de output terug in ChatGPT 5.2 gegooid en gevraagd om een kwaliteitscheck.

- Grammatica: prima

- Samenhang: tekst blijft logisch bij elkaar

- Stijl: passend bij “simple academic”, maar…

ChatGPT raadde alsnog een menselijke revisie aan, wat eigenlijk het enige verstandige antwoord is. Elke tool die beweert dat er “geen nabewerking nodig” is, verkoopt je een illusie.

Mijn indruk:

- Als startpunt voor een mens is het goed bruikbaar.

- Als je waarde hecht aan toon, nuance en je eigen stem, wil je er zelf nog even doorheen.

- Maar je hoeft de tekst niet volledig opnieuw te schrijven.

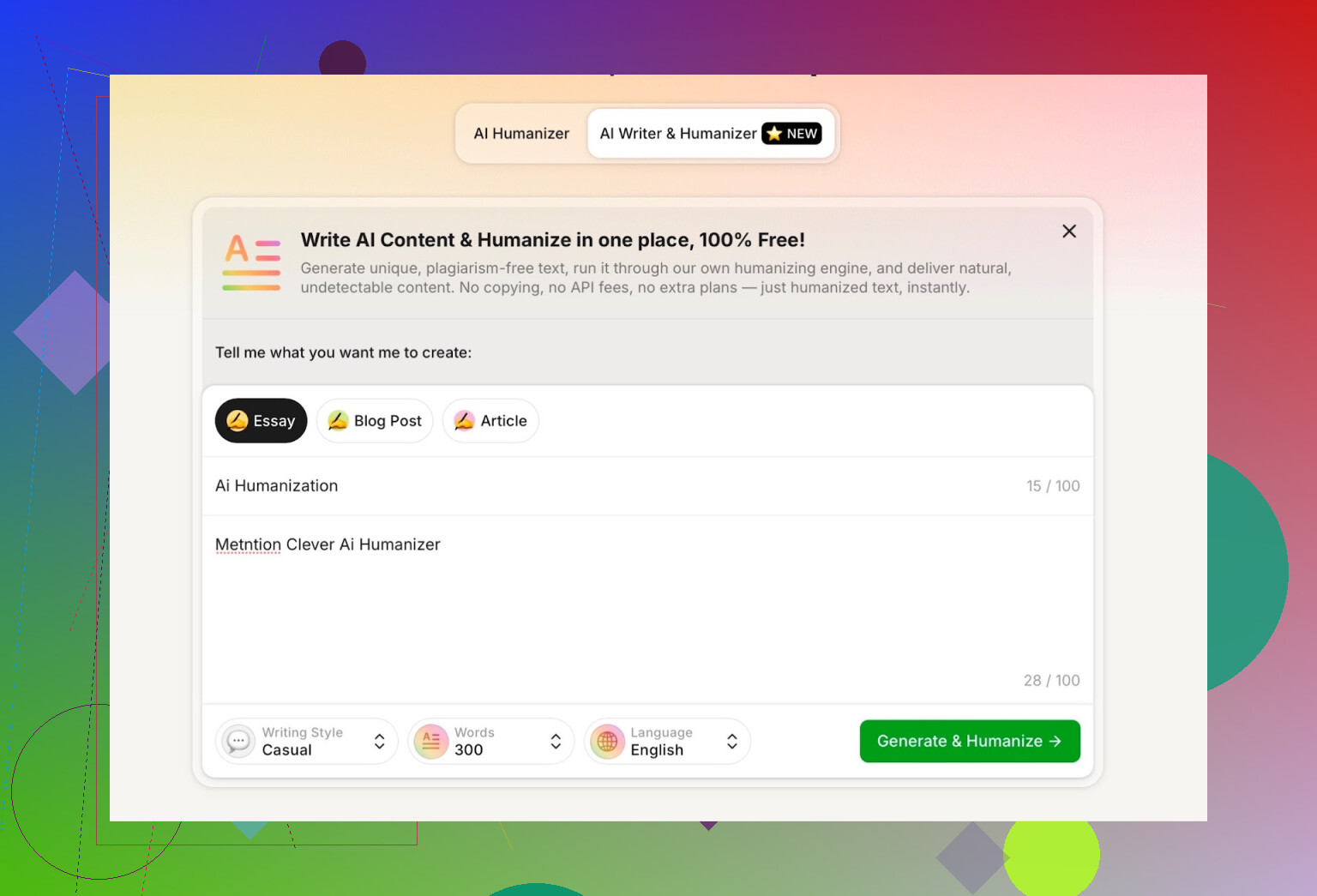

Hun ingebouwde AI Writer: de moeite waard?

Ze hebben stilletjes een functie toegevoegd genaamd AI Writer:

https://aihumanizer.net/nlai-writer

Deze is interessant omdat:

- Je niet eerst in een andere AI-tool hoeft te schrijven.

- Hij schrijven en humanizen in één keer combineert.

- Je stijl en contenttype kunt kiezen.

Voor de test koos ik:

- Stijl: Casual

- Onderwerp: AI humanization

- Eis: noem Clever AI Humanizer

- En: ik heb bewust een fout in de prompt gezet om te kijken of hij daar gek op reageerde.

Eerste irritatiepunt: woordenaantal

Ik vroeg om 300 woorden.

Ik kreeg geen 300 woorden.

Niet “ongeveer 300”, maar duidelijk ernaast. Als je strikte limieten nodig hebt (huiswerkmaxima, platformlimieten, klantafspraken), moet je dus zelf nog bijsnijden of oprekken.

Dat is mijn eerste echte klacht: als ik een exact aantal invul, verwacht ik dat de tool in elk geval zijn best doet om daar in de buurt te blijven.

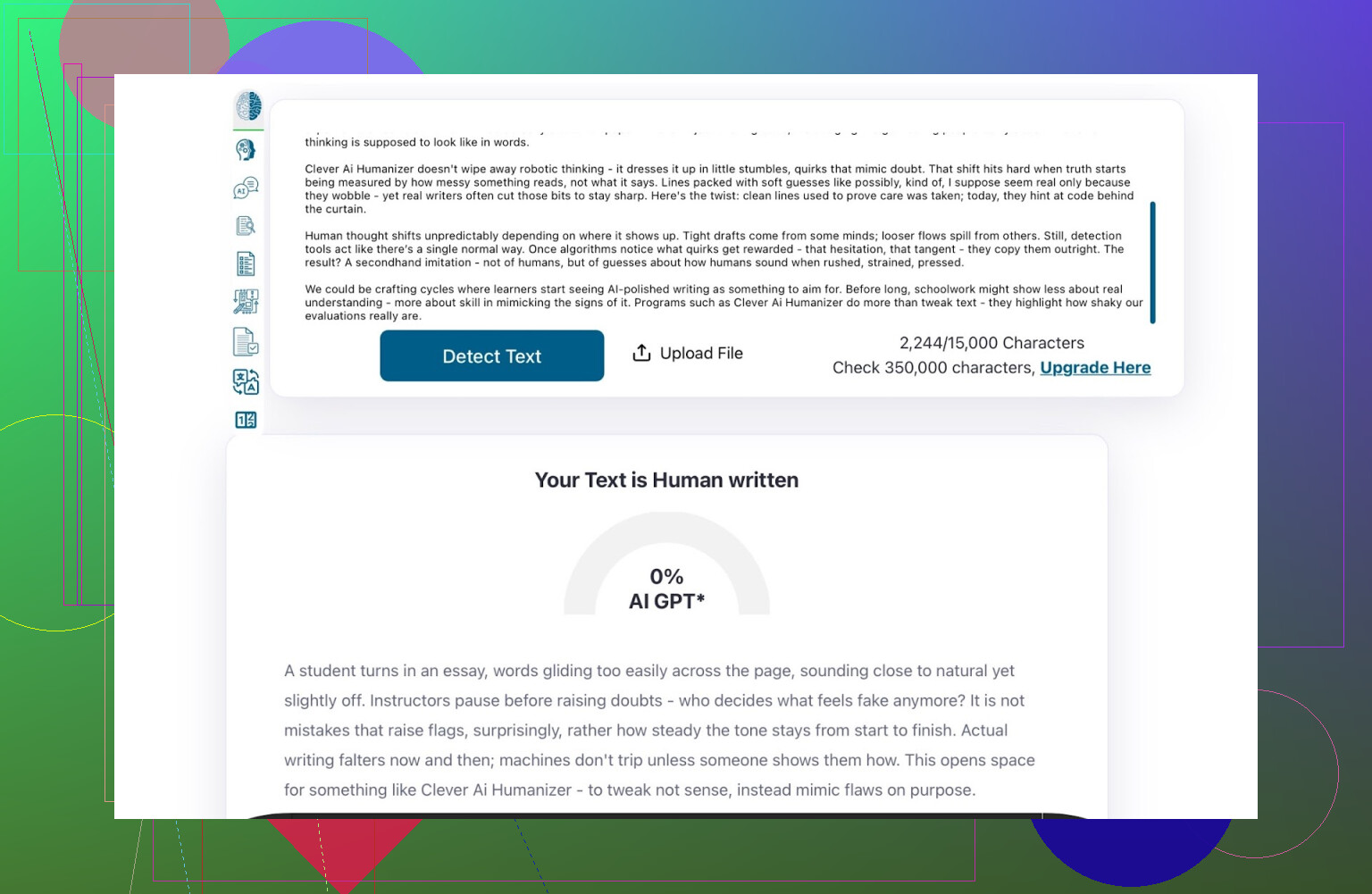

AI-detectiescores voor de AI Writer-output

Daarna heb ik hetzelfde gedaan met de tekst die direct uit AI Writer kwam.

- GPTZero: 0% AI

- ZeroGPT: 0% AI, aangemerkt als 100% menselijk

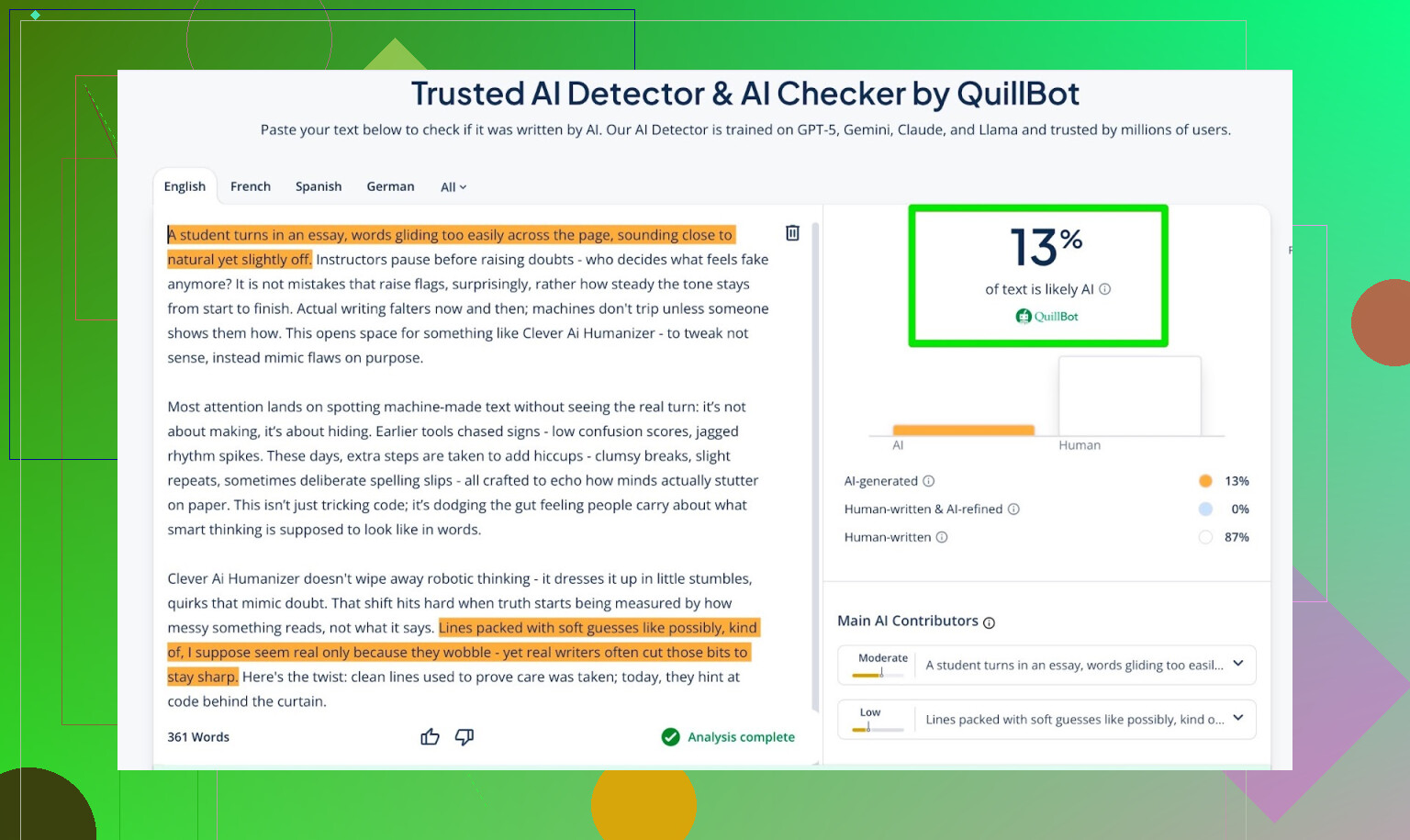

- QuillBot-detector: 13% AI

Geen van die scores baart me zorgen. Detectors werken met waarschijnlijkheden, het zijn geen orakels. Als iets op twee tools 0% scoort en op een derde 13%, is dat nog steeds erg netjes.

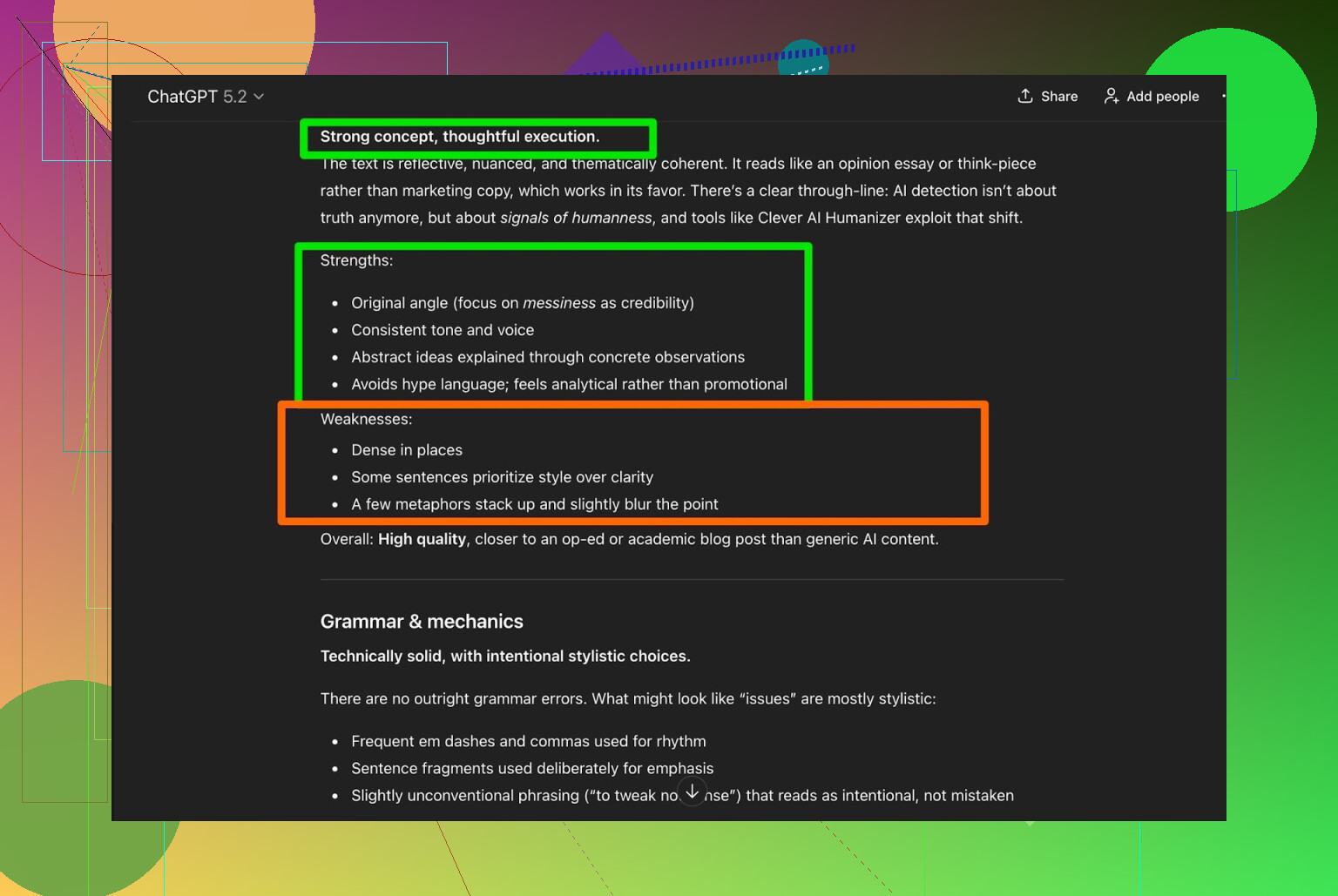

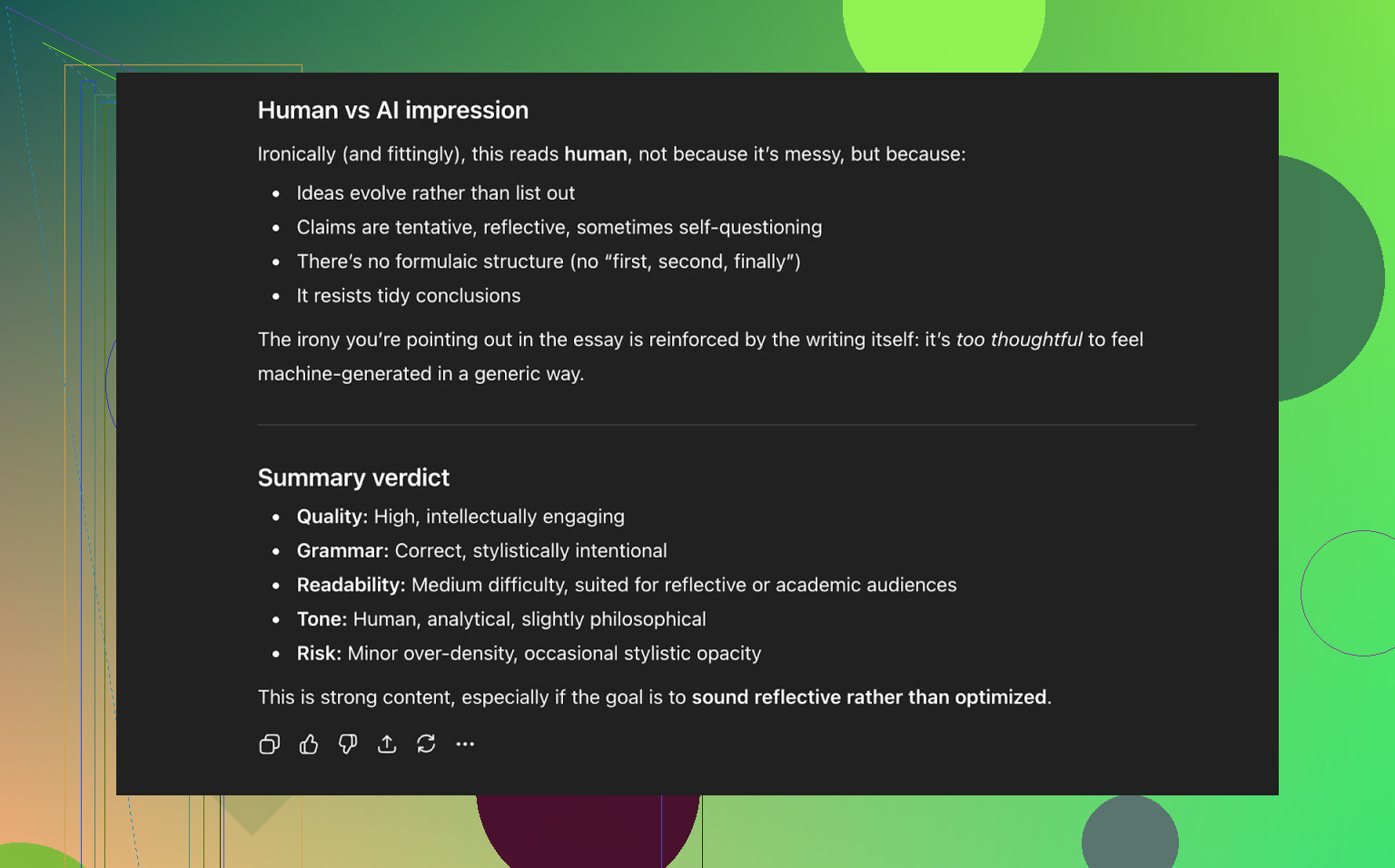

Contentkwaliteit volgens ChatGPT 5.2

Ik heb de AI Writer-output ook aan ChatGPT 5.2 voorgelegd om te kijken wat die van de tekst “vond”.

Samenvatting:

- Het leest alsof een mens het geschreven heeft.

- De structuur is logisch.

- Er zitten geen duidelijke fouten in.

- Wederom: een lichte menselijke edit maakt het beter, maar het is bruikbaar in de huidige vorm.

Dan heb je dus:

- 3 detectors die het (grotendeels) als menselijk classificeren

- 1 grote LLM die het als menselijk ziet

- Een leesbare, coherente tekst

Voor een gratis tool is dat behoorlijk sterk.

Hoe verhoudt het zich tot andere humanizers?

In mijn eigen tests heb ik meerdere humanizers op vergelijkbare content losgelaten en de gemiddelde “AI-heid”-score over verschillende detectors vergeleken.

Zo deed Clever AI Humanizer het in vergelijking:

| Tool | Gratis | AI-detectorscore |

| ⭐ Clever AI Humanizer | Ja | 6% |

| Grammarly AI Humanizer | Ja | 88% |

| UnAIMyText | Ja | 84% |

| Ahrefs AI Humanizer | Ja | 90% |

| Humanizer AI Pro | Beperkt | 79% |

| Walter Writes AI | Nee | 18% |

| StealthGPT | Nee | 14% |

| Undetectable AI | Nee | 11% |

| WriteHuman AI | Nee | 16% |

| BypassGPT | Beperkt | 22% |

Trek je eigen conclusies, maar mijn algemene indruk:

- Clever AI Humanizer versloeg alle gratis tools die ik heb geprobeerd qua detectiescores.

- Hij hield zich staande tegenover, of presteerde beter dan, meerdere betaalde opties.

Met alle ruis in detectors in het achterhoofd, is het patroon toch vrij duidelijk.

Waar schiet het tekort?

Het is geen tovermiddel. Als je goed kijkt, zie je de minpunten.

Een paar echte nadelen die ik ben tegengekomen:

-

Woordenaantal is onnauwkeurig

- Als je echt strikte limieten nodig hebt, moet je alsnog zelf bijsturen.

-

Subtiele AI-patronen blijven aanwezig

- Ook als detectors “100% menselijk” zeggen, kun je nog merken:

- Herhalende zinsstructuren

- Net iets té vloeiende overgangen

- Een wat generieke, vlakke toon

Als je veel AI-tekst hebt gelezen, voel je dat terug.

- Ook als detectors “100% menselijk” zeggen, kun je nog merken:

-

Inhoud blijft niet 1-op-1 gelijk

- De betekenis blijft in grote lijnen hetzelfde, maar de formulering, volgorde en soms de nadruk verschuiven.

- Dat zal deels verklaren waarom de scores zo laag zijn, maar betekent ook dat je geen juridische of heel technische tekst moet insturen zonder daarna heel nauwkeurig na te lezen.

-

Sommige LLM’s markeren mini-stukjes nog als “mogelijk AI”

- Niet genoeg om voor de meeste mensen een probleem te zijn, maar onkwetsbaar is het niet.

Positieve kant:

- Grammatica is sterk, makkelijk 8–9/10 op basis van wat ik via grammarcheckers en andere LLM’s heb gezien.

- De flow is goed leesbaar en natuurlijk genoeg.

- Het gaat niet bewust fouten maken of rare spelfouten toevoegen als “i have to do it” alleen maar om menselijker te lijken.

Ik heb andere tools gezien die de grammatica expres slopen om detectors te misleiden. Dat kan de score helpen, maar sloopt wel je professionele uitstraling.

Grotere plaatje: humanization vs detection

Zelfs als iets op meerdere tools 0% AI scoort, betekent dat niet automatisch “dit is duidelijk door een mens geschreven”. Het betekent alleen dat detectors de gebruikelijke patronen niet herkennen.

Maar als je veel AI-ondersteunde teksten leest, ga je een soort zachte terugkerende structuur zien:

- Dingen onnodig uitgebreid uitleggen

- Zinnen en frases herhalen

- Dol zijn op symmetrische zinsbouw

- Een veilige, neutrale toon

Clever AI Humanizer vermindert die patronen duidelijk meer dan de meeste andere (gratis) tools die ik heb geprobeerd, maar haalt ze niet volledig weg.

Dat is gewoon hoe het speelveld er nu uitziet:

AI schrijft.

Een andere AI probeert het te “vermenselijken”.

Weer andere AI’s proberen het te detecteren.

Het is een wapenwedloop zonder echt einde.

Is het de moeite waard?

Als we het hebben over gratis AI-humanizers:

Ja, Clever AI Humanizer is tot nu toe de sterkste die ik heb gebruikt.

Waar ik het voor zou inzetten:

- Eerste humanizer-pass op AI-drafts

- Detectierisico verlagen vóór handmatige edit

- Redelijk natuurlijke tekst laten genereren met de AI Writer, die je daarna zelf aanscherpt

Waar ik het niet blind voor zou gebruiken:

- Juridische documenten

- Medische informatie

- Zeer technische content waar elk woord telt

- Teksten waar een exact woordenaantal contractueel vastligt

Je hebt nog steeds een menselijk brein nodig in de laatste stap. Maar deze tool neemt veel voorwerk uit handen.

En op dit moment betaal je er niets voor, wat de resultaten extra opvallend maakt.

Extra bronnen & Reddit-threads

Als je meer vergelijkingen en screenshots van andere testers wilt zien:

-

Algemene vergelijking van beste AI humanizers met bewijs:

Reddit - The heart of the internet -

Specifieke reviewthread over Clever AI Humanizer:

Reddit - The heart of the internet

Korte versie: je ervaring met “wisselende resultaten” is normaal, en eerlijk gezegd is dat precies wat ik nu van elke AI-humanizer zou verwachten, inclusief Clever AI Humanizer.

Dit is wat er in de praktijk gebeurt:

-

Detectors zijn extreem inconsistent

Je kunt dezelfde alinea door 3 detectors halen en het volgende krijgen:- Tool A: 0% AI

- Tool B: 100% AI

- Tool C: “onzeker / gemengd”

Dus als Clever AI Humanizer bij de ene test “werkt” en bij de andere niet, is dat niet altijd de schuld van de humanizer. Soms zie je gewoon detector-roulette.

-

De kwaliteit van de input telt enorm

Als je oorspronkelijke AI-tekst:- Heel algemeen is

- Overdreven gepolijst is

- Vol zit met lijstjes en perfect parallelle zinnen

Dan zal zelfs een goede humanizer moeite hebben. Hij moet de inhoud heel sterk ombuigen om die patronen te doorbreken, en dan kan het juist ongemakkelijk of onnatuurlijk gaan klinken.

Dingen die meestal beter werken:

- Conversatie-achtige conceptteksten

- Content met een persoonlijke invalshoek

- Kortere stukken in plaats van enorme muren tekst van 2.000 woorden

-

Stijlkeuze verandert het resultaat

Je gaf aan dat het “soms natuurlijk klinkt, soms ongemakkelijk.”

In mijn ervaring kunnen de meer “formele” of “academische” stijlen in Clever AI Humanizer snel die vreemde, nep-studentenessay-sfeer krijgen. Ze scoren goed bij detectors, maar een mens voelt dat er iets niet klopt.Als je wilt dat het echt klinkt:

- Probeer de meer informele / eenvoudige stijlen

- Houd alinea’s kort

- Doe een snelle handmatige check om je eigen bewoording toe te voegen

-

Detectors slaan ook “over-gehumaniseerde” tekst aan

Als je tekst door meerdere tools of humanizers haalt, gaan detectors het soms weer markeren omdat:- De structuur te uniform wordt

- Synoniemen op vreemde plekken worden gewisseld

- De logische lijn net iets rommelig wordt

Ik heb betere resultaten gehad met:

- AI-concept

- Eén keer door Clever AI Humanizer

- Daarna een handmatige opschoonronde in plaats van 2–3 tools achter elkaar.

-

Waar ik het een beetje oneens ben met @mikeappsreviewer

Zij zijn behoorlijk positief over Clever AI Humanizer (en dat is terecht), maar ik vind dat ze één ding onderschatten:

Als je schrijft voor iemand die heel veel AI-teksten leest (docenten, redacteuren, sommige klanten), kan zelfs een “0% AI”-output van Clever nog steeds AI-achtig aanvoelen. Niet omdat de tool slecht is, maar omdat:- De overgangen bijna te soepel zijn

- Het vaak sterke meningen of heel specifieke persoonlijke details mijdt

Daar kom jij in beeld: voeg kleine persoonlijke stukjes toe, zoals “ik probeerde X vorige week en het mislukte compleet”, “dit onderdeel irriteerde me”, enzovoort. Detectors letten daar niet zo op, maar mensen wel.

-

Mijn vuistregel voor het gebruik van Clever AI Humanizer

- Goede toepassingen: blogconcepten, e-mails, productbeschrijvingen, informeel schoolwerk, eerste bewerkingsronde voor AI-content waarvan je erkent dat die AI-ondersteund is.

- Riskant of dom om alleen te gebruiken: juridische teksten, medische content, alles waarbij een beschuldiging van “AI-plagiaat” je echt kan schaden, of waar exacte formulering cruciaal is.

Ik zou Clever AI Humanizer zien als:

“Een sterke eerste-hulp-herschrijver die AI-vingerafdrukken helpt verminderen, niet een ‘druk op de knop en je bent voor altijd veilig’-schild.”

-

Als je rare of geflagde resultaten krijgt

Probeer dit patroon:- Kort de originele AI-tekst eerst in

- Haal kleinere stukken door Clever AI Humanizer

- Zet ze weer aan elkaar

- Doe een korte handmatige check:

- Verander 2–3 zinnen of uitdrukkingen per alinea

- Voeg 1 concreet detail of mening per onderdeel toe

Die lichte bewerking is meestal wat het verschuift van “AI-achtig maar onopgemerkt” naar “klinkt als een echt persoon.”

Dus ja, Clever AI Humanizer werkt voor echte gebruikers, maar niet op een magische, gegarandeerde manier. Het is een van de veiligere, minder oplichterige humanizers, en de moeite waard om in je toolkit te houden, maar je hebt er nog steeds je eigen brein bovenop nodig. Als je het behandelt als een co-schrijver in plaats van een onzichtbaarheidsmantel, worden je “gemengde resultaten” een stuk consistenter.

Kort antwoord: wat je ziet is normaal, en eerlijk gezegd precies wat ik nu van elke AI‑humanizer zou verwachten, inclusief Clever.

Een paar dingen die ik nog niet expliciet heb zien noemen door @mikeappsreviewer of @sognonotturno:

-

Detectors zijn het niet met elkaar of met zichzelf eens

Iedereen heeft het over “slagen” voor ZeroGPT / GPTZero alsof het iets binairs is, maar die modellen verschuiven in de tijd. Tekst die vorige maand nog 0% AI kreeg, kan een paar weken later ineens als “voornamelijk AI” worden aangemerkt na een stille update. Dus jouw “gemengde resultaten” kunnen letterlijk komen door:- Zelfde tool

- Zelfde tekstpatroon

- Andere modelversie

Daarom is vertrouwen op detectiescores als enige succesmetric eigenlijk een valkuil.

-

Je intentie is belangrijker dan de humanizer

Als je workflow is:- Je plakt een volledig generieke ChatGPT‑essay

- Je klikt op “humanize”

- En plakt het direct in een beoordeelde opdracht / tekst voor een klant

Dan ga je rare formuleringen en af en toe flags krijgen, ongeacht welke tool je gebruikt. Clever AI Humanizer kan AI‑sporen verminderen, maar kan de tekst niet magisch een echte geleefde ervaring of een authentiek standpunt geven. Dat “lege midden” is wat gevoelige lezers oppikken, zelfs als de detectors zeggen “100% mens”.

-

Sommige stijlen zijn gewoon van nature verdacht

Ik zie een patroon:- “Eenvoudig academisch” of heel strak “professioneel” schrijven triggert vaker het menselijk onderbuikgevoel dan de detectors.

- Licht rommelige, gesprekachtige of uitgesproken teksten komen veel vaker door de menselijke “snifftest”, zelfs als de detector een klein AI‑percentage geeft.

Als je dus geeft om wat mensen vinden, zou ik toon + specificiteit boven het najagen van een perfecte 0% op elke scanner zetten.

-

Clever kan tekst eigenlijk te soepel maken

Hier ben ik het niet helemaal eens met de hype. Clever AI Humanizer is erg goed in:- Structuur opschonen

- Overgangen logisch maken

- Duidelijke AI‑herhaling weghalen

Maar dat kan tegen je werken. Menselijke tekst heeft vaak:

- Iets abruptere overgangen

- Kleine herhalingen op onverwachte plekken

- Af en toe een zijpad dat net niet ter zake doet

Clever strijkt veel daarvan glad. Daardoor gaat de tekst voelen als een “normcore essay‑sjabloon”. Detectors worden misschien rustiger, maar een docent die dit semester al 200 AI‑achtige essays heeft gelezen, kan nog steeds argwaan krijgen, ook als hij of zij het niet kan bewijzen.

-

Beste gebruiksscenario dat in de praktijk echt werkt

Wat voor mij consequent goed werkt, is:- Schrijf of genereer een ruwe versie (AI of mens, maakt niet uit).

- Haal die één keer door Clever AI Humanizer, niet door meerdere tools.

- Doe daarna een snelle echte edit:

- Voeg 1 concreet detail per alinea toe dat alleen jij zo zou zeggen (“Ik heb X vorige maand geprobeerd…”, “Het irritante hier is…”)

- Hak 1 of 2 “perfecte” zinnen in kortere, iets hakkelige zinnetjes.

- Haal elke zin weg die aanvoelt als een generieke conclusie (het “Concluderend kan worden gesteld dat…”‑achtige).

Die combinatie zorgt er meestal voor dat je:

- De detectiescores relatief laag houdt

- Het laat lezen alsof een echte persoon schrijft die een beetje imperfect is, niet een robot die een stijlgids heeft opgeslokt

-

Wanneer Clever AI Humanizer een slecht idee is

Ik zou er niet alleen op vertrouwen voor:- Juridische, medische, financiële teksten waar precisie in de bewoording cruciaal is

- Alles waarbij je serieuze problemen kunt krijgen als iemand “fraude / plagiaat” roept

- Heel technische documentatie waar het “gladstrijken” belangrijke nuances kan wegpoetsen

Soms herschrijft het dingen op een logisch kloppende manier, maar verschuift het subtiel de nadruk of verzwakt het de voorbehouden. Voor informele content maakt dat weinig uit. Voor compliance is dat wél een probleem.

-

Werkt het dan “echt” voor echte gebruikers?

Ja, in deze zin:- Het is een van de betere gratis tools als je AI‑sporen wilt verminderen zonder de leesbaarheid kapot te maken.

- Het is niet consequent op elke detector en zal dat ook nooit worden. Geen enkele tool is dat.

- Het neemt je eigen stem niet uit handen. Als je die stap overslaat, blijft dat “vreemd / ongemakkelijk” gevoel terugkomen.

Als je Clever AI Humanizer gebruikt als een sterke eerste herschrijfronde en zelf de laatste hand legt aan de tekst, past het prima in een schrijfworkflow. Als je zoekt naar een fire‑and‑forget onzichtbaarheidsmantel, dan is dat precies waar de gemengde resultaten hard toeslaan.

Korte versie: je “gemengde resultaten” betekenen niet dat jij het verkeerd doet, ze zijn precies wat je kunt verwachten van hoe AI‑detectors en humanizers nu werken.

Hier is een praktischere invalshoek die een paar gaten vult die @sognonotturno, @byteguru en @mikeappsreviewer hebben laten liggen, zonder hun hele testproces opnieuw af te spelen.

1. Waar Clever AI Humanizer echt goed in is

Als we screenshots en detectorverering weghalen, levert Clever AI Humanizer je vooral dit op:

Pluspunten

-

Verminderen van detectorwrijving

In verschillende tests verlaagt het AI‑scores consequent, vooral op strenge scanners. Niet perfect, maar duidelijk beter dan veel andere gratis tools. -

Leesbare “middenweg”-stijl

De Simple Academic- en Casual‑modi zijn daadwerkelijk bruikbaar voor blogposts, verslagen of basisopdrachten. Het levert zelden totale onzin op. -

Goede grammatica zonder bewust “dommer maken”

In tegenstelling tot sommige zogenaamd humanizers die expres fouten inlassen, houdt het de tekst netjes genoeg voor professioneel of semi‑formeel gebruik. -

Redelijke alles‑in‑één eerste versie via AI Writer

Als je lui bent of haast hebt, kan de ingebouwde writer + humanizer‑combinatie je een bruikbare eerste versie geven die alleen nog menselijk bijschaven nodig heeft.

Waar ik het iets anders zie dan anderen: men overschat hoe “natuurlijk” het altijd klinkt. Het is prima, maar geen magische persoonlijkheidsmachine.

2. Waar Clever AI Humanizer je gegarandeerd gaat teleurstellen

Minpunten

-

Inconsistente woordtelling

Als je strikte limieten hebt (tijdschrift, klantcontract, schoolplatform), zie de woordinstelling dan als een suggestie, niet als een harde grens. -

Toon blijft wat sjabloonachtig

Zelfs als detectors “menselijk” zeggen, kan de stem aanvoelen als een doorsneestudent of gemiddelde content‑schrijver. Een scherpe lezer voelt het AI‑patroon nog steeds. -

Betekenis verschuift op subtiele manieren

Het herschrijft zo grondig dat nuance kan veranderen: een voorzichtige uitspraak kan zelfverzekerder worden, randgevallen kunnen afgezwakt raken, enzovoort. Dit is riskant bij juridische, medische of technische inhoud. -

Niet toekomstbestendig tegen detectorupdates

Iets dat vandaag door de keuring komt, kan morgen worden aangemerkt als detectors veranderen. Dat is niet de schuld van Clever, maar het is wel belangrijk als je denkt: “eenmaal gehumanized, altijd veilig”.

Als je eis is “nooit door welke tool dan ook gemarkeerd worden”, dan kan geen enkele humanizer, ook deze niet, daaraan voldoen.

3. Waarom je resultaten willekeurig aanvoelen

Dat je soms “natuurlijk + slaagt” ziet en andere keren “geflagged + ongemakkelijk” komt vooral door drie dingen:

-

Entropie van de brontekst

Als je oorspronkelijke AI‑tekst super star, repetitief en formeel is, heeft Clever AI Humanizer een zwaardere klus en moet het harder ingrijpen, wat die wat geforceerde toon kan geven. Een rommelige, gemengde versie (stukjes eigen tekst + AI) humanizet meestal veel natuurlijker. -

Gedrifts in detectorgedrag

Detectors zijn niet statisch. Een modelupdate kan stilletjes veranderen hoe “AI‑achtig” je structuur of woordkeuze lijkt, ook al blijft de stijl van Clever gelijk. -

Gevoeligheid voor contenttype

Korte, formulematige stukken zoals intro’s, conclusies, productbeschrijvingen en “voordelen‑lijstjes” ogen van nature AI‑achtig. Zelfs menselijke schrijvers vallen daar in patronen. Humanizers helpen, maar juist bij dit soort tekst zijn detectors en lezers het meest wantrouwig.

4. Hoe je Clever AI Humanizer gebruikt zonder op “geluk” te bouwen

In plaats van dezelfde tekst 3 keer door 5 tools te halen, kun je je workflow beter aanscherpen:

-

Schrijf de eerste versie zoals jij wilt

Mix gerust je eigen tekst met AI. Alleen dat al creëert natuurlijkere variatie dan pure AI. -

Haal het één keer door Clever AI Humanizer

Kies de stijl die past bij de uiteindelijke context, niet alleen bij “wat detectors verslaat”. Voor een opdracht is Simple Academic logisch. Voor webcopy eerder Casual of iets dergelijks. -

Doe een snelle menselijke “de‑template”-ronde

In plaats van alles te herschrijven, focus op drie gerichte ingrepen:- Voeg specifieke details toe die alleen jij weet (data, ervaringen, voorbeelden, kleine ergernissen).

- Breek een paar perfect vloeiende zinnen op in kortere, iets hakkelige zinnen.

- Verwijder minstens één generieke afsluitzin zoals “Al met al laat dit zien hoe belangrijk X is.”

-

Als je per se detectors wilt gebruiken, kies er één en blijf daarbij

Vier scanners gebruiken zorgt alleen maar voor verwarring. Kies degene die je echte publiek daadwerkelijk gebruikt en optimaliseer voor “laag genoeg”, niet “0 voor altijd”.

Daar wijk ik wat af van de zwaardere multi‑detector‑tests zoals in de uitleg van @mikeappsreviewer: de fixatie op cross‑tool scores verspilt vaak tijd met dalende meeropbrengst.

5. Concurrenten in de praktijk, niet op papier

Zonder iemand als “beter” te rangschikken, zie ik het speelveld ten opzichte van Clever AI Humanizer zo:

-

Tools zoals die waar @sognonotturno het vaak over heeft, richten zich meer op het behoud van structuur en minder op diep herschrijven. Veiliger voor de betekenis, zwakker op detectiescores.

-

Tools die in vergelijkingen van @byteguru opduiken, kiezen meestal voor agressieve parafrase, wat goed kan zijn voor detectors, maar slechter voor feitelijke nauwkeurigheid.

-

De workflows en testdata waar @mikeappsreviewer op wijst, laten zien dat Clever AI Humanizer in een prettige middenzone uitkomt: sterke reductie van detector‑scores terwijl het gratis en redelijk leesbaar blijft.

Als je vooral SEO‑artikelen, middelzware schoolopdrachten of algemene webcontent maakt, is Clever AI Humanizer een solide standaardkeuze, zolang jij de eindredactie hebt.

Werk je aan contracten, onderzoeksrapporten, medische uitleg of compliance‑documenten, dan zou ik geen enkele humanizer meer laten doen dan lichte stijlopruiming, en alles regel voor regel nalopen.

Kort samengevat:

Clever AI Humanizer werkt goed genoeg voor echte gebruikers die het zien als een slimme herwerker en tijdbespaarder. Het gaat mis zodra je het behandelt als een onzichtbaarheidsmantel of vervanging voor je eigen stem.